Pillole

I problemi delle linee guida per l’adozione dell’intelligenza artificiale in tutti gli ordini e gradi di istruzione: tra clamorose assenze, contraddizioni e ossimori. L’ennesima riforma calata dall’alto. Ma un’altra strada è possibile

Al rientro a scuola, studenti, famiglie e docenti hanno trovato l’ennesima sorpresa: un dettagliato libriccino contenente le linee guida per una rapida adozione – naturalmente consapevole, responsabile e senza ulteriori oneri a carico del bilancio – dell’intelligenza artificiale in tutti gli ordini e gradi di istruzione.

A una prima analisi, le linee guida sembrano proseguire nella spinta verso l'adozione di tecnologie digitali non facilmente controllabili dagli attori della scuola, con un forte rischio che si riproponga lo scenario già visto con i progetti PNRR Scuola 4.0: una corsa a spendere fondi per introdurre hardware e software, senza possibilità di scelta consapevole da parte delle scuole, terminata in un sostanziale trasferimento di fondi pubblici al privato. L'enfasi sull'innovazione tecnologica e sulla transizione digitale delle scuole raramente tiene conto delle esigenze didattiche della comunità scolastica, per puntare l'obiettivo su un mero accumulo di tecnologie che si rivelano ingestibili dalle scuole, vuoi per incapacità, vuoi perché le tecnologie adottate sono spesso opache, o anche perché delegate completamente a imprese private.

L'articolo di Mazzoneschi e Barale (C.I.R.C.E.) è uscito nel quotidiano Domani.

Vivere le tecnologie come se fossero qualcosa che cade dall’alto ci rende passivi e ci limita a considerare “cosa fanno” senza concentrarci sul “perché lo fanno”. È il tema centrale del libro The Mechanic and the Luddite – A Ruthless Criticism of Technology and Capitalism, scritto dal ricercatore americano Jathan Sadowski, i cui studi si concentrano sulle dinamiche di potere e profitto connesse all’innovazione tecnologica.

“Le nuove tecnologie possono catturare quantità di dati così vaste da risultare incomprensibili, ma quei dati sul mondo resteranno sempre incompleti. Nessun sensore o sistema di scraping può assorbire e registrare dati su tutto. Ogni sensore, invece, è progettato per raccogliere dati su aspetti iper-specifici. Ciò può sembrare banale, come un termometro che può restituire un numero sulla temperatura, ma non può dirti che cosa si provi davvero con quel clima. Oppure può essere più significativo, come un algoritmo di riconoscimento facciale che può identificare la geometria di un volto, ma non può cogliere l’umanità soggettiva e il contesto sociale della persona. I dati non potranno mai rappresentare ogni fibra dell’essere di un individuo, né rendere conto di ogni sfumatura della sua vita complessa.

Ma non è questo lo scopo né il valore dei dati. Il punto è trasformare soggetti umani integrati in oggetti di dati frammentati. Infatti, ci sono sistemi che hanno l’obiettivo di conoscerci in modo inquietante e invasivo, di assemblare questi dati e usarli per alimentare algoritmi di targeting iper-personalizzati. Se questi sistemi non stanno cercando di comporre un nostro profilo completo e accurato possibile, allora qual è lo scopo?

Ecco però un punto importante: chi estrae dati non si interessa a noi come individui isolati, ma come collettivi relazionali. I nostri modi di pensare la raccolta e l’analisi dei dati tendono a basarsi su idee molto dirette e individualistiche di sorveglianza e informazione.

Ma oggi dobbiamo aggiornare il nostro modo di pensare la datificazione – e le possibili forme di intervento sociopolitico in questi sistemi guidati dai dati – per includere ciò che la giurista Salomé Viljoen chiama ‘relazioni “orizzontali’, che non si collocano a livello individuale, ma a scala di popolazione. Si tratta di flussi di dati che collegano molte persone, scorrono attraverso le reti in modi tali che le fonti, i raccoglitori, gli utilizzatori e le conseguenze dei dati si mescolano in forme impossibili da tracciare se continuiamo a ragionare in termini di relazioni più dirette e individualistiche.

Leggi l'intervista completa , che ha molti altri spunti interessanti, sul sito di Guerre di rete

Con lo sviluppo dell’intelligenza artificiale i data center consumano sempre più acqua, lasciando a secco intere comunità

Una famiglia che abita nella contea di Newton, a un’ora e mezza in macchina da Atlanta, da diversi anni ha problemi con l’acqua. Racconta infatti il New York Times che dal 2018 la lavastoviglie, la macchina del ghiaccio, la lavatrice e il gabinetto hanno smesso uno per uno di funzionare. Poi, nel giro di un anno, la pressione dell’acqua si è ridotta a un rivolo. Finché dai rubinetti del bagno e della cucina non usciva più acqua. Nulla. Ma il problema, ovviamente, non riguarda solo questa famiglia.

[...]

Tutto questo perché? Perché dal 2018, appunto, è cominciata la costruzione del nuovo data center di Meta. I data center sono immensi centri di elaborazione dati che in breve tempo sono diventati la spina dorsale della nostra economia. Sono l’infrastruttura critica che alimenta l’archiviazione cloud, i servizi di emergenza, i sistemi bancari, le comunicazioni e la logistica. Ma sono i data center sono strutture gigantesche che consumano quantità immense di energia, suolo e acqua. Con il rapido sviluppo dell’intelligenza artificiale, questi consumi sono destinati a crescere a ritmo esponenziale.

Il caso di Jason Lemkin, dirigente d’impresa e investitore, che si è lasciato ammaliare dalle promesse dell’azienda di IA Replit, rischiando di perdere l’intero database di produzione: il cuore pulsante della sua attività professionale.

A partire dal 12 luglio, il co-fondatore di Adobe EchoSign e SaaStr ha documentato via blog la sua esperienza personale con il vibe coding. Il primo approccio è stato idilliaco: adoperando un linguaggio naturale, il manager è riuscito “in una manciata di ore a costruire un prototipo che era molto, molto fico”. Un inizio estremamente promettente, soprattutto considerando che Replit si propone alle aziende come una soluzione accessibile anche a chi ha “zero competenze nella programmazione”, promettendo di far risparmiare alle aziende centinaia di migliaia di dollari. Leggendo tra le righe, la promessa implicita è chiara: sostituire i tecnici formati con personale più economico, supportato dall’IA.

La premessa, tuttavia, è stata presto messa alla prova. “Dopo tre giorni e mezzo dall’inizio del mio nuovo progetto, ho controllato i costi su Replit: 607,70 dollari aggiuntivi oltre al piano d’abbonamento da 25 dollari al mese. Altri 200 dollari solo ieri”, ha rivelato Lemkin. “A questo ritmo, è probabile che spenderò 8.000 dollari al mese. E sapete una cosa? Neanche mi dispiace”. Anche perché, a detta del manager, sperimentare con il vibe coding è una “pura scarica di dopamina”, e Replit è “l’app più assuefacente” che abbia mai usato.

Dopo poco, il manager si è reso conto che...

Riporto un testo di Alberto Messina apparso su Linkedin.

E' da tempo che rimescolo nella testa un’analogia un po’ strana, ma che continua a sembrarmi feconda - oggi voglio condividerla per divertirmi con voi in qualche discussione:

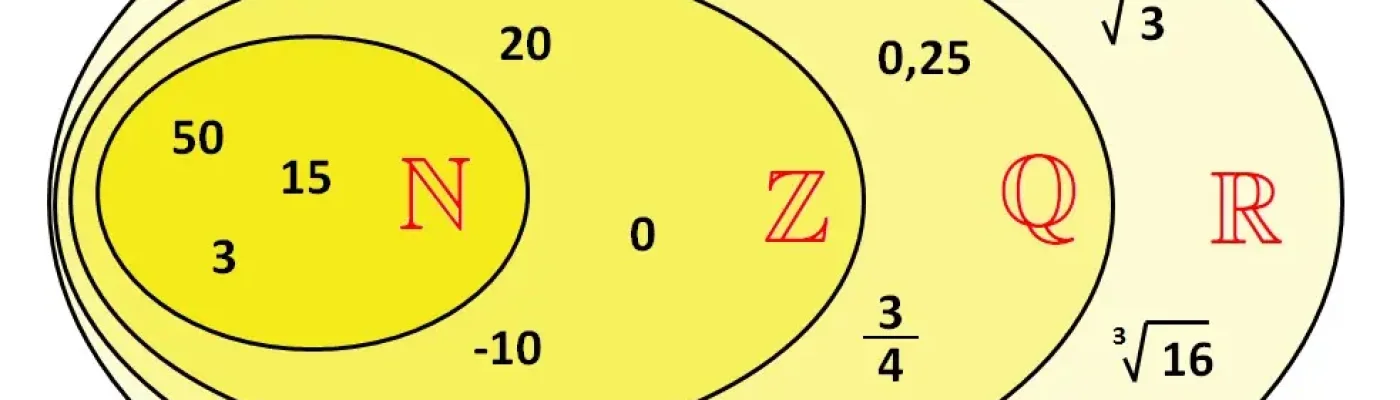

Il testo generato da un LLM sta al linguaggio umano come i numeri razionali stanno ai numeri reali.

A prima vista può sembrare poetica o azzardata, a seconda vista una supercazzola, ma esprime un punto per me importante.

I numeri razionali sono densi: tra due numeri reali qualsiasi, ce n’è sempre uno razionale. Computabili, regolari, enumerabili, possiamo generarli con regole fisse. I numeri reali, invece, includono gli irrazionali: incomprimibili, non numerabili, e molti di essi non possono essere calcolati da alcun algoritmo in maniera compiuta in un tempo finito.

Ora pensiamo ai LLM.

Essi generano testo prevedendo statisticamente il prossimo token, sulla base di grandi quantità di dati. Il risultato è fluente e denso nello spazio delle frasi plausibili. Ma, come i razionali, questa fluidità è vincolata: nasce da operazioni computabili, all’interno di un set finito di token. Non possono autonomamente inventare nuovi token, né deviare radicalmente dal sistema che li genera. Il linguaggio umano, invece, è un continuo creativo e aperto. Esso è situato in corpi, culture, storie, è affettivo, ambiguo, non deterministico. E' espandibile: possiamo coniare parole, sovvertire grammatiche, rompere aspettative. E' onomatopeico e sonoro: possiamo dire “zot!”, “sgnac”, “brummm”, “fiuuu”, senza regole o significati condivisi, ma certi che qualcuno capirà.

Infine, è spesso non computabile non perché sia casuale, ma perché è immerso in una realtà vissuta e storicamente aperta.

Una differenza profonda emerge anche dall'analogia con un principio dell’analisi matematica: l’assioma degli intervalli incapsulati: in ℝ una sequenza di intervalli "sempre più stretti" converge a un punto esatto (si perdoni la sintesi).

Nel linguaggio umano, possiamo raffinare indefinitamente ciò che vogliamo dire, e arriviamo proprio al significato, a quel concetto vissuto e condiviso con gli altri.

In un LLM, al contrario, anche con prompt sempre più precisi, si resta sempre intorno, in una serie di approssimazioni che non contengono mai davvero il punto. A me capita spesso di interagire son un chatbot per qualche minuto e poi di uscire dall'interazione per completare, per dare la pennellata essenziale al concetto.

Come le approssimazioni razionali di π, il testo di un LLM può avvicinarsi molto a quello umano. Ma c’è sempre un residuo, qualcosa che manca: la trama stessa del significato, dell’intenzione, della possibilità inventiva, del puro gioco fonico.

Questo non è un rifiuto dei LLM le loro capacità sono straordinarie. E' un promemoria: la fluidità sintattica non equivale alla profondità semantica. E l’approssimazione statistica non è comunicazione vissuta.

Non scambiamo uno spazio denso per un continuum reale.

Restiamo curiosi su ciò che questi modelli possono fare ma anche lucidi su ciò che non possono.

Lezioni di Cassandra/ L'alter ego di Cassandra ha fatto una chiacchierata eretica sulle false IA in un paio di eventi pubblici, apparentemente con una certa soddisfazione dei presenti; perché allora non trasformare gli appunti in una esternazione vera e propria, salvandoli dall'oblio digitale?

Se oggi siamo in questa situazione è tutta colpa di Joseph Weizenbaum, noto eretico dell'informatica. Anzi, è colpa di Joseph Weizenbaum e della sua segretaria. Ma andiamo con ordine.

Nell'ambito dell'intelligenza artificiale, una delle pietre miliari più conosciute è stato ELIZA, un programma informatico sviluppato appunto da Weizenbaum nel 1966, che ha rivoluzionato la nostra comprensione delle interazioni tra l'uomo e la macchina. Eliza, sebbene rudimentale rispetto agli standard odierni, ha gettato le basi per molte delle tecnologie di chatbot e assistenti virtuali che utilizziamo oggi.

[...]

In 70 anni di storia dell'IA sono stati sviluppati i motori di inferenza, le reti neurali, le tecniche di apprendimento profondo: tutte cose che nei loro ambiti funzionano benissimo. Se non li avete mai sentiti nominare, ricorderete certo le notizie che l'IA referta le TAC meglio di un radiologo e che ha battuto i campioni mondiali di scacchi e Go (dama cinese). Tre anni fa una tecnologia già nota da tempo, gli LLM (Large Language Models — Grandi modelli di Linguaggio) ha cominciato a funzionare. Perché? Per semplici motivi di scala, cioè l'utilizzo di server più potenti per eseguirli e di più informazioni con cui allenarli.

La speculazione finanziaria delle dotcom in cerca di nuove opportunità di far soldi ci si è buttata a pesce. Improvvisamente ChatGPT e i suoi fratelli sono diventati disponibili a chiunque gratuitamente: hanno cominciato ad affascinare tutti esattamente come Eliza aveva fatto con la segretaria di Weizenbaum. Ma, come Eliza, un LLM non sa niente, non comprende niente, non può rispondere a nessuna domanda e nemmeno rispondere sempre nello stesso modo.

Una segnalazione di lettura della Stultiferanavis: un paper pubblicato con accesso libero su Arxiv.org dal titolo Your Brain on ChatGPT: Accumulation of Cognitive Debt when Using an AI Assistant for Essay Writing Task

In modo disomogeneo e non così diffuso come molti raccontano, un numero crescente di persone e di aziende fa ricorso ogni giorno a strumenti di IA generative e ai modelli LLM. Interrogarsi su benefici ed effetti di questi comportamenti può risultare utile, forse anche interessante.

E’ ciò che ha fatto un gruppo di ricercatori con lo studio “Your Brain on ChatGPT: Accumulation of Cognitive Debt when Using an AI Assistant for Essay Writing Task”, pubblicato su Arxiv.org.

Lo studio si è concentrato sull’individuazione del costo cognitivo derivante dall’utilizzo di un LLM on un contesto particolare, quello legato alla scrittura di un saggio.

Leggi l'articolo di Carlo Mazzucchelli

Se siete fra gli utenti delle app di Meta, come Facebook, Instagram o WhatsApp, fate attenzione alle domande che rivolgete a Meta AI, l’assistente basato sull’intelligenza artificiale integrato da qualche tempo in queste app e simboleggiato dall’onnipresente cerchietto blu. Moltissimi utenti, infatti, non si rendono conto che le richieste fatte a Meta AI non sempre sono private. Anzi, può capitare che vengano addirittura pubblicate online e rese leggibili a chiunque. Come quella che avete appena sentito.

E sta capitando a molti. Tanta gente sta usando quest’intelligenza artificiale di Meta per chiedere cose estremamente personali e le sta affidando indirizzi, situazioni mediche, atti legali e altro ancora, senza rendersi conto che sta pubblicando tutto quanto, con conseguenze disastrose per la privacy e la protezione dei dati personali: non solo i propri, ma anche quelli degli altri.

Questa è la storia di Meta AI, di come mai i dati personali degli utenti finiscono per essere pubblicati da quest’app e di come evitare che tutto questo accada.

Benvenuti alla puntata del 16 giugno 2025 del Disinformatico, il podcast della Radiotelevisione Svizzera dedicato alle notizie e alle storie strane dell’informatica.

Ascolta il podcast o leggi la trascrizione della puntata di Paolo Attivissimo

L’esperta di tecnologia ha pubblicato un libro - Empire of AI | Inside the reckless race for total domination - che descrive un nuovo imperialismo in cui poche aziende tech si arricchiscono sfruttando dati comuni e risorse naturali

“L’intelligenza artificiale è come un impero dove il potere è accentrato nelle mani di pochi che si arricchiscono sfruttando le risorse delle comunità più vulnerabili. Il rischio più grande di permettere a questi imperi di IA di continuare ad operare è una completa perdita di potere di autodeterminazione del nostro futuro. In quel mondo la democrazia non può sopravvivere”. Karen Hao è un’esperta di tecnologia (ex direttrice della rivista MIT Tech Review e corrispondente tech da Hong Kong per il Wall Street Journal) ed è arrivata a questa conclusione dopo essere stata embedded per tre giorni dentro OpenAI e aver condotto 300 interviste a personaggi che gravitano attorno al suo fondatore Sam Altman, oltre ad ex dirigenti ed impiegati di Meta, Microsoft, Google, DeepMind e Anthropic. Gli imperatori.

- UNA NUOVA ERA COLONIALE

- INTELLIGENZA INSOSTENIBILE

- CERVELLI AI-DIPENDENTI

- LA SOLUZIONE?

Apple pubblica uno studio che smaschera i limiti dell’intelligenza artificiale: i modelli di AI non “pensano”, ma collassano di fronte a problemi complessi. La corsa verso la vera AGI sembra più lontana che mai.

Negli ultimi giorni, Apple ha scosso il mondo della tecnologia con la pubblicazione di un whitepaper che mette in discussione le fondamenta stesse dell’intelligenza artificiale moderna. Il documento, dal titolo provocatorio “The Illusion of Thinking: Understanding the Strengths and Limitations of Reasoning Models via the Lens of Problem Complexity” ossia ''L’illusione del pensiero: comprendere i punti di forza e i limiti dei modelli di ragionamento attraverso la lente della complessità dei problemi'', rappresenta una vera e propria bomba sganciata sul settore AI. Dietro la facciata: l’AI non ragiona, imita

Il cuore della ricerca è semplice ma devastante: i Large Language Model (LLM), quei sistemi che oggi chiamiamo “AI” e che aziende come OpenAI, Google e Meta sbandierano come capaci di “pensare”, in realtà non ragionano affatto. Sono semplicemente eccezionali nel riconoscere pattern e riprodurre risposte plausibili, ma quando si tratta di affrontare problemi complessi, la loro presunta intelligenza si sbriciola.