Pillole

Il luddismo, l'agire di quelle operaie e di quegli operai che agli inizi del 1800 prendevano a martellate o a zoccolate le macchine che toglievano loro lavoro, è comunemente giudicato atteggiamento retrogrado ed infantile. Ad uno sguardo più attento, il luddismo appare invece il primo passo, del tutto comprensibile ed anzi necessario, di reazione ad una novità. L'energia inizialmente indirizzata verso l'inutile attacco alla macchina trova negli anni immediatamente successivi una destinazione costruttiva. Nascono così le mutue, i sindacati, i partiti dei lavoratori. Oggi ci troviamo esattamente nella stessa situazione: seguire i luddisti nel non subire passivamente, trovare vie per rispondere costruttivamente. Questo articolo è stato rifiutato nel 2017 dalla rivista 'Prometeo'. Il motivo: è pessimista, fosco. Ma come scrivo nella conclusione "Credo che ci convenga essere turbati, spaventati, come lo erano i luddisti". Il turbamento è il necessario passaggio iniziale verso una presa di coscienza che si traduce in azione. Ripubblico qui l'articolo senza cambiare una virgola.

Apriamo la puntata parlando delle ultime svolte in maniera di Intelligenza Artificiale, in particolare facendo il quadro dell'ingresso delle industrie cinese nel mercato dei Large Language Models e provando a discutere dei risultati del CHIPS Act: è servito, o i recenti sviluppi mostrano che era ormai troppo tardi?

Ci spostiamo poi al mondo dei social media, segnalando la decisione di ValigiaBlu di uscire, oltre che da X, anche dalle piattaforme di Meta. Evidentemente il video di Zuckerberg che si inchina a Trump ha segnato un precedente, per quanto ci sembra che le principali criticità fossero già insite.

Nuovo caso di Malware sviluppato da aziende israeliane, e diffuso tramite Whatsapp. Molte le persone coinvolte, in decine di paesi, tra cui l'Italia. L'unico nome che conosciamo è proprio quello di un giornalista italiano, Francesco Cancellato, direttore di Fanpage.it.

Notiziole varie: dall'impatto delle sanzioni sul software libero, a come battere il boss finale della Nintendo, passando per l'utilizzo dell'Intelligenza Artificiale nelle indagini.

Il capo di OpenAI ha annunciato a inizio anno che il suo nuovo modello di intelligenza artificiale avrebbe ottenuto risultati simili a quelli umani in una sorta di test del quoziente intellettivo. Un esito ottenuto però facendo allenare la macchina sulle stesse domande e in modo poco trasparente, con costi ecologici ed economici fuori scala. È ora di disertare questa agenda, fatta di macchine mangia-soldi e mangia-risorse.

Il 2025 si apre con fuochi d’artificio superiori a quelli a cui ci eravamo abituati sul fronte della propaganda attorno all’intelligenza artificiale (Ai).

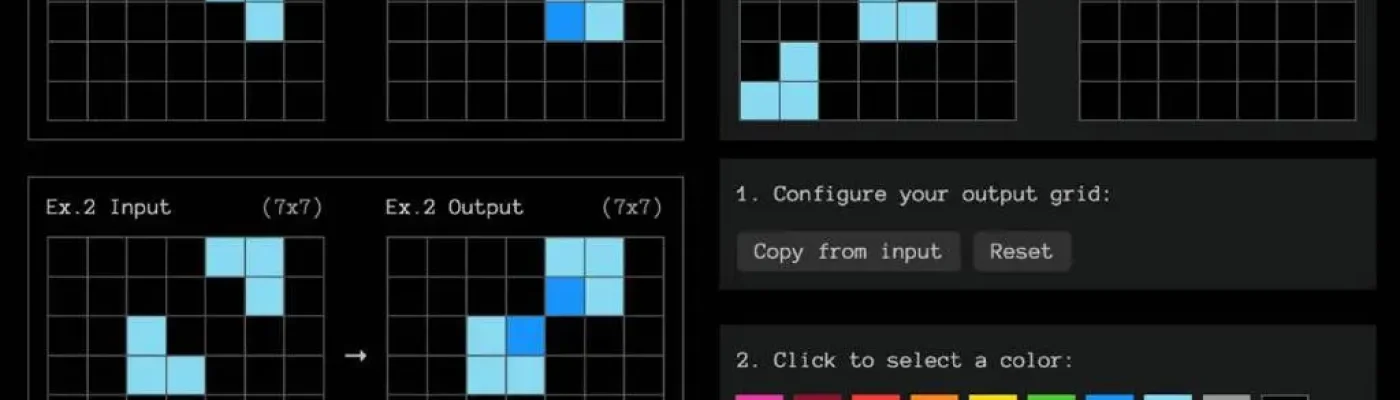

Il nuovo modello prodotto da OpenAI avrebbe infatti raggiunto risultati comparabili con gli esseri umani nel risolvere il test ARC-AGI. Il video qui sopra contiene un esempio delle domande contenute in tale test, che ricorda molto da vicino i test del quoziente intellettivo (Qi) utilizzati in psicologia per “misurare l’intelligenza” degli esseri umani. Sorvoleremo in questa sede su due fatti chiave che richiederebbero invece una seria analisi: non esiste un consenso scientifico su che cosa sia l’intelligenza umana e animale, ossia una definizione condivisa e, anche fingendo di aver raggiunto un consenso, misurarla resterebbe tutta un’altra faccenda. Dal punto di vista “teorico” ci limiteremo a richiamare l’etimologia: “inter” più “ligere”, “leggere tra (le cose)”, leggere in profondità.

Sam Altman (più in generale l’intero comparto dell’Ai) ci ha abituato a trucchi degni degli artisti della truffa che giravano il suo Paese a inizi Ottocento, usati a supporto di affermazioni-bomba come quella appena citata (e immediatamente seguita da affermazioni ancora più esplosive sulla “Superintelligenza”). Ricordiamo, a titolo d’esempio non esaustivo, la figuraccia di Google alla presentazione del suo Gemini, quando i suoi padroni raccontarono che il modello in questione sapeva riconoscere il gioco della morra cinese al primo colpo (zero-shot), mentre -guardando il video completo- si scopriva che la verità era molto diversa (e i dettagli, in questo campo, sono molto importanti).

Con l'autrice Cristina Iurissevich presentiamo "E se i troll mangiassero i cookie?" (Eris) un libro per sopravvivere nell'era digitale. Con lei ragioniamo del senso dell'autodifesa digitale con un occhio, oltre che alla sorveglianza statale e aziendale, alle relazioni con le persone a noi vicine. Parliamo quindi di sexting, di diffusione non consensuale di immagini intime, di nudifier, di fiducia nelle persone e nelle tecnologie.

Concludiamo un commento sulle recenti rivelazioni che mostrano un ruolo dello stato francese nella trasformazione dell'AI Act in una direzione che desse sempre più potere alle polizie e ai militari.

Lunedì 3 febbraio alle ore 15.00 presso la sede Cobas di Terni, via Cesi 15/a, presentazione di “L’intelligenza inesistente. Un approccio conviviale all’intelligenza artificiale” di Stefano Borroni Barale. Ne parlano l'autore e Franco Coppoli.

Intelligenza artificiale (Ai) è un termine che raggruppa tecnologie molto diverse tra loro, con una lunga storia. I tifosi dell’Ai sostengono che questa tecnologia abbia il potenziale di risolvere alcuni dei problemi più urgenti del mondo, come il cambiamento climatico, la povertà e le malattie. I critici, invece, sostengono che questa tecnologia sia pericolosa e ingannevole.

Ma perché tutti parlano di Ai? Perché è un’eccezionale operazione di marketing: una delle meglio organizzate degli ultimi anni. Su questa le imprese della Silicon Valley si stanno giocando il tutto per tutto, per invertire il trend negativo fatto di tagli al personale e cambi drastici dei loro programmi di sviluppo. Per comprendere quali siano le aspettative di queste aziende – e quali dovrebbero essere le nostre – in questo libro si ricostruiscono le tappe, le intuizioni e i paradossi che hanno attraversato la comunità scientifica, provando a tracciare una linea che collega Alan Turing, primo sostenitore dell’Ai forte, con i creatori di ChatGPT, il software in grado di sostenere un dialogo credibile con un essere umano.

L’incontro sarà fruibile anche online usando il software Jitsi a questo link https://meet.jit.si/altercobas

Impazza DeepSeek, nuova AI cinese: per gli Usa un nuovo "momento Sputnik. Made in China 2025: per il progetto voluto da Xi è tempo di bilanci. E buon anno del serpente :)

Allora: la nuova versione è uscita poco dopo Natale, pare sia all’altezza di OpenAI e affini, è realizzata con solo una parte dei chip (ad esempio quelli Nvidia) bloccati dagli Usa verso la Cina. E fa parlare di sé come la prima forma di AI che riporta in qualche modo all’AGI (Artificial General Intelligence) specie la release R1. Insomma in ogni caso un po’ tutti hanno detto la stessa cosa: DeepSeek ha colmato un divario. E per gli Usa è arrivato un altro “momento Sputnik”, quello nel quale ci si rende conto che un competitor è più avanti (come capitò nel caso dello Sputnik sovietico, appunto, o come capitò alla Cina dopo la vittoria delle AI di Google contro il campione del mondo di go, allora si parlò di momento Sputnik, ma per la Cina)

Ora, ci sono molti tecnicismi al riguardo ma non solo perché DeepSeek ha segnato l’inizio di una nuova era nell’AI cinese, quella del risparmio: “DeepSeek è stato rapidamente soprannominato il "Pinduoduo dell'IA" e altri grandi giganti della tecnologia come ByteDance, Tencent, Baidu e Alibaba non hanno potuto trattenersi, tagliando i prezzi uno dopo l'altro. Una guerra dei prezzi per i modelli di grandi dimensioni in Cina era imminente”. E a differenze di aziende di stato “che bruciano soldi, in sussidi, DeepSeek è redditizia”.

Vediamo intanto di cosa stiamo parlando. DeepSeek è un'azienda cinese di intelligenza artificiale che sviluppa modelli linguistici di grandi dimensioni open-source. L'azienda è finanziata esclusivamente dal fondo speculativo cinese High-Flyer. Sia DeepSeek che High-Flyer hanno sede a Hangzhou, Zhejiang. DeepSeek è stata fondata nel maggio 2023 da Liang Wenfeng, un ex studente dell'Università di Zhejiang che ha iniziato a fare trading durante la crisi finanziaria del 2007-2008.

L’11 settembre 1973 viene rovesciato il governo di Salvador Allende. L’episodio segna storicamente l’ascesa del neoliberismo. Insieme al colpo di stato politico, però, ve ne è stato un altro che ha segnato la storia dell’informatica e che ha portato all’attuale sviluppo dell’Intelligenza Artificiale secondo una direzione determinata da un preciso apparato politico-economico-militare-culturale. Ne parliamo con il professore Andrea Cerroni, docente all’Università Bicocca di Milano, che, da sempre, approfondisce questi e altri temi e che ci ha spiegato la correlazione tra Salvador Allende e l’informatica.

Storicizzare, criticizzare, conoscere sono, oggi, le armi fondamentali per scalfire la retorica che avvolge sia il neoliberismo sia la tecnologia digitale e decostruire la loro capacità di imporsi “ontologicamente”, come necessità e dato di fatto incontrovertibile, inibendo la possibilità di immaginare altro: altre strade, altre soluzioni, altri digitali, altre società.

Abbiamo incontrato il professore Andrea Cerroni, docente all’Università Bicocca di Milano, che, da sempre, approfondisce questi e altri temi e ci ha spiegato la correlazione tra Salvador Allende e l’informatica. Che cosa lega IA e neoliberismo; per quale motivo è stato modificato il titolo di uno dei testi più importanti della cibernetica cancellando l’originale “uso umano degli esseri umani”; come è possibile ipotizzare una “tecnologia umanistica”, che da Dante arriva ad Adriano Olivetti (che ha inventato il primo PC della storia). Cerroni ci fa anche una raccomandazione: chiamiamola “Artificial Intelligence, perché nella traduzione italiana si perde il collegamento con i Servizi (segreti o meno)”.

Il 2024 delle intelligenze artificiali si è concluso con molti annunci e rilasci di nuovi strumenti da parte delle principali aziende impegnate nello sviluppo di queste tecnologie. Come da manuale delle trovate di marketing di Sam Altman, la OpenAi si è riservata il finale a effetto. L’azienda, che aveva addirittura organizzato un calendario dell’avvento per svelare una alla volta le proprie novità, ha anticipato o3, il suo nuovo modello.

o3 non è ancora disponibile al pubblico: solo chi fa ricerca nell’ambito della sicurezza dei sistemi di ia può ottenere un accesso anticipato.

Sappiamo poco di o3. Da quel che si può leggere online, si basa ancora sull’architettura degli altri modelli della OpenAi. Quel che lo rende interessante, però, è il fatto che è stato valutato da un progetto che si chiama Arc prize. L’Arc prize è’un premio da un milione di dollari riservato a chiunque riesca a far risolvere ai modelli linguistici alcuni test chiamati Arc-agi che sono particolarmente ostici per le macchine.

Versione non integrale e privo dell’apparato delle note, di un articolo uscito sul numero 64 della rivista Le nuove frontiere della scuola.

Questo breve dialogo è la continuazione e la sintesi di un confronto molto fecondo, che dura ormai da tempo, sulle tematiche del digitale e su un’idea della tecnologia non asservita ai grandi interessi economici. L’intenzione è quella di liberare la riflessione attorno alle nuove tecnologie, e all’Intelligenza artificiale in particolare, dal pensiero magico e dal tecnoentusiasmo del PNRR sulla scuola

Luca Malgioglio: Stefano, la lettura del tuo bellissimo libro sull’intelligenza artificiale mi ha aiutato a chiarire un paio di questioni che mi piacerebbe approfondire ulteriormente insieme a te. La prima la porrei così: l’intelligenza artificiale, come molte altre cose, ci viene presentata come un prodotto senza storia, un dato di fatto tecnologico di fronte al quale l’unico approccio possibile sarebbe quello di capire come utilizzarlo...

L’introduzione dell’intelligenza artificiale in medicina dovrebbe essere valutata caso per caso, e con grande attenzione. È una tecnologia tutt’altro che neutra, soggetta al problema delle “allucinazioni” e non sempre rispettosa dei protocolli tipici della ricerca scientifica. Errori metodologici pericolosi che un certo marketing asfissiante vuole cancellare. L’analisi di Stefano Borroni Barale

“Cosa succede quando abbiamo messo la decisione [sulla vita o morte di un paziente, ndr] nelle mani di un’inesorabile macchina a cui dobbiamo porre le giuste domande in anticipo, senza comprendere appieno le operazioni o il processo attraverso cui esse troveranno risposta?”. Norbert Wiener, “God and Golem, Inc.”, 1963.

Questa citazione ha aperto un recente congresso sull’uso dell’Intelligenza artificiale (Ai) in ambito sociosanitario durante il quale era intenzione di chi scrive provocare un dibattito per cercare di uscire dallo “spettro delle opinioni accettabili” (Noam Chomsky) e -al contempo- ampliare la comprensione del fenomeno, ripercorrendone la storia.