Pillole

Fragili dal punto di vista sia tecnico sia organizzativo. Si presentano così le aziende sanitarie italiane di fronte agli attacchi informatici, per lo più di tipo ransomware (cioè diretti al pagamento di un riscatto), dei gruppi criminali internazionali che, ormai da anni, le prendono di mira. La conseguenza è la pubblicazione di informazioni estremamente sensibili riguardanti migliaia di cittadini.

Secondo quanto è stato possibile ricostruire da Guerre di Rete, attraverso le informazioni rilasciate sui siti ufficiali delle cyber gang, solo negli ultimi due mesi del 2023 sono stati diffusi oltre 1,5 terabyte di dati sanitari (circa due milioni di file) sottratti a diverse strutture del nostro Paese. Dati che includono cartelle cliniche, fotografie di pazienti affetti da tumori cutanei, referti di abusi sessuali, esami per le malattie ereditarie, e liste dei vaccinati al Covid-19. Stando alle nostre fonti, alcuni file contengono persino nome, cognome e data di nascita di persone che sono state assistite dai centri di salute mentale, o dai servizi per le dipendenze patologiche. Un patrimonio enorme pubblicato sul dark web, la parte della Rete a cui si può accedere tramite specifici software, e che è alla portata di tutti.

Nella puntata del 28 gennaio apertura sulle proteste di Mozilla a proposito dei modi in cui i browser indipendenti (quindi principalmente il suo Firefox) vengono penalizzati. Uno dei principali è relativo al fatto che su Apple sono proibiti sia browser indipendenti come app a sé stanti, sia l'utilizzo dei motori di browser all'interno di app. La situazione è, in teoria, cambiata, almeno per chi vive in Unione Europea. Andiamo a vedere alcuni dettagli tecnici che ci fanno capire come i recenti cambi non risolvono completamente la situazione.

Continuiamo con una piccola analisi del sistema di allerta terremoti fatto da Google. Funziona? Come? Ma soprattutto, ti traccia?

Andiamo verso la chiusura raccontando di uno dei nostri utilizzi preferiti del nostro software preferito: Excel per fare analisi statistica in ambito accademico, Excel per truccare i dati, analisi forense dei file di Excel per dimostrare che era stato intenzionale.

In ultimo, HP ci confessa che vuole una relazione (abusiva) con i suoi clienti.

Pubblicato un documento consultivo del Commissario per la Salute che identifica l’accesso e l’uso incontrollato delle piattaforme come un pericolo per la salute pubblica. Il sindaco Eric Adams: “I giovani vanno protetti”

I social media sono un pericolo per la salute pubblica a causa del loro effetto sulla salute mentale dei giovani. È la posizione ufficiale della città di New York, che su iniziativa del sindaco Eric Adams ha pubblicato un documento consultivo del Commissario per la Salute che identifica l’accesso e l’uso incontrollato delle piattaforme come dannoso. È la prima grande città degli Stati Uniti a compiere un passo del genere.

Amazon France Logistique, l’azienda che gestisce i magazzini del grande e-commerce statunitense Amazon in Francia, ha ricevuto una multa da 32 milioni di euro dalle autorità francesi per aver «creato un sistema di sorveglianza» dei dipendenti «eccessivamente intrusivo». La sanzione è stata emessa il 27 dicembre, ma è stata resa pubblica martedì dalla Commissione nazionale dell’informatica e delle libertà (CNIL), l’autorità incaricata di assicurare l’applicazione della legge sulla tutela dei dati personali in Francia.

È come il romanzo di Charles Dickens, Racconto di due città. Da una parte l’Italia, che sembra aver capito d’un tratto l’importanza degli investimenti nel settore dei semiconduttori e le Zone Economiche Speciali (Zes) per il Mezzogiorno – ovvero aree geografiche che offrono una serie di incentivi, agevolazioni e semplificazioni amministrative alle imprese che stabiliscano lì la propria sede. E dall’altro l’Irlanda, che ha incassato per più di sessant’anni il dividendo delle Zes e da più di trenta quello della produzione di semiconduttori. Due storie parallele che, almeno nelle aspirazioni della politica italiana, dovrebbero a un certo punto diventare convergenti. Ma non è chiaro con quali tempi.

Leggi l'articolo sul sito "Guerre di rete"

Leggi anche la newsletter di questa settimana curata da Carola Frediani.

In questo numero:

- Una guida all’AI Watermarking

- OpenAI si prepare alle elezioni

- Interferenze GPS sul Baltico

- I microchips fanno gola all’Europa e all’Italia

Nella puntata due interviste. La prima a Noemie, di La quadrature du Net. La seconda a Paul Biggar, importante startupper della Silicon Valley e a favore della Palestina.

Quadrature du net Intervista a Noemie, del progetto La quadrature du Net. Analiziamo alcuni dei passaggi chiave che hanno attraversato la societa’ francese a partire dagli attentati di Parigi del 2015 per capire come hanno influenzato il sistema di sorveglianza tecnologica fino ad arrivare ai piu’ recenti processi a carico di attivist*.

Paul Biggar Dalle stelle delle startup della Silicon Valley a militante per la Palestina in pochi giorni. Una storia esemplificativa delle tensioni che si muove come un unico corpo a sostegno di Israele.

In fine puntata varie notizie interessanti

Un'inchiesta in Francia. Uno dei pezzi più importanti del welfare, la Caisse d’allocations familiales (Caf), l’ente che si occupa degli aiuti sociali alle famiglie in difficoltà, per molto più di un decennio ha funzionato affidandosi solo a un algoritmo che discriminava i precari e i più svantaggiati. Dopo anni di battaglia Quadrature du Net è riuscita ad analizzare il codice sorgente. Ecco i risultati

La Quadrature du Net, una delle più serie, autorevoli, combattive associazioni per i diritti sociali e digitali in Europa – non una delle tante che si limita a firmare appelli on line – assieme a due collettivi di ricerca – Stop Controls e Changer de Cap – dopo una lunga, estenuante battaglia è riuscita ad ottenere il codice sorgente dell’algoritmo utilizzato dalla Caf.

Il codice sorgente è quello che definisce il “flusso d’esecuzione” di un programma, è la sequenza di istruzioni. Per usare l’espressione della Quadrature è la “formula” utilizzata per istruire il suo funzionamento.

Quel codice sorgente è stato analizzato in ogni dettaglio (codice, elenco delle variabili, ponderazioni, ecc), anche qui con un lavoro lunghissimo. E dettagliatissimo. E’ venuta fuori la foto di una moderna distopia. Dove la filosofia della sorveglianza automatizzata si sposa con la “caccia” agli ultimi, ai precari, a chi è in difficoltà. “Sospettati” di essere imbroglioni quasi di default.

Windows 11 ha imposto requisiti hardware molto più severi rispetto al predecessore e, secondo diverse stime, la fine del supporto di Windows 10 potrebbe aumentare i rifiuti RAEE in maniera significativa, a partire da ottobre 2025.

I vecchi PC, tuttavia, spesso non meritano di essere messi da parte: ancora funzionanti, possono continuare ad assolvere funzioni di qualche utilità ancora oggi. Le migliori distro Linux per i PC datati possono trasformare macchine ormai legate al passato in dispositivi efficienti e funzionanti, riportandoli a una seconda giovinezza. È questo lo spirito con cui vogliamo offrire una serie di suggerimenti di distribuzioni Linux per mantenere vivi computer che ormai sentono il peso del tempo.

Nella puntata del 21 gennaio si parla di Piracy Shield, il sistema di contrasto alla "pirateria" che dovrebbe entrare in vigore il 31 Gennaio.

Previsto dal DL Caivano con il fantomatico pretesto di contrastare il disagio giovanile online (?), si tratta di un sistema automatico in grado di bloccare i siti di streaming entro 30 minuti. I giornali ne parlano come della (ennesima) soluzione definitiva, e puntualizzano che sarebbe pensato per gli eventi sportivi. Vediamo quanto c'è di vero.

A seguire il solito misto di notiziole su copyright, privacy e sorveglianza.

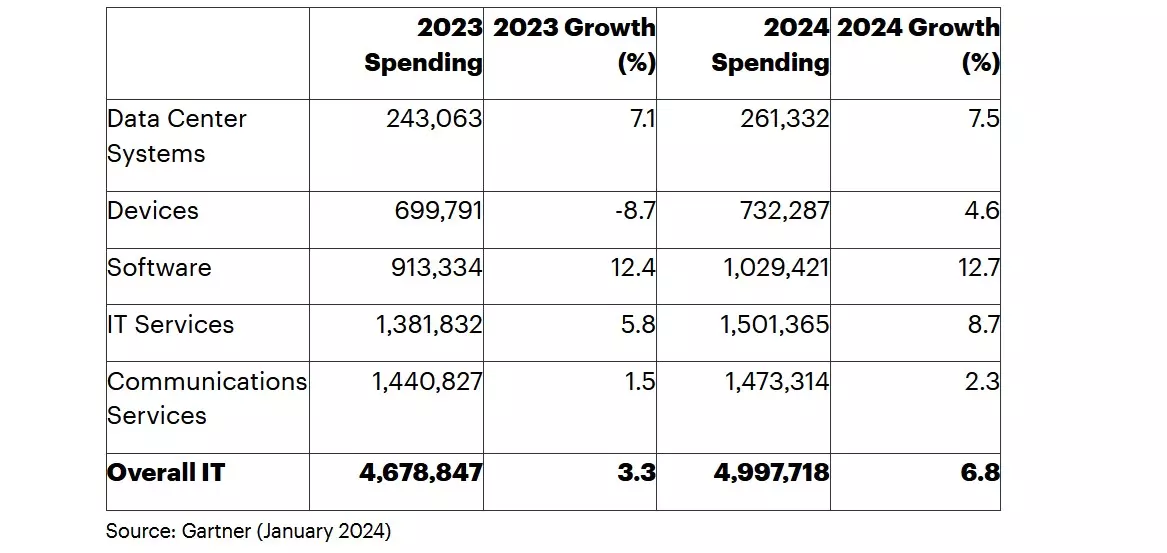

Il giro d’affari 2024 stimato in 5mila miliardi di dollari, una crescita del 6,8% rispetto all’8% preventivato appena tre mesi fa. Per la prima volta i servizi IT supereranno quelli di comunicazione. E riguardo all’intelligenza artificiale, nonostante l’hype, l’impatto in termini di spesa non sarà significativo. Le aziende avviano sperimentazioni ma il focus resta concentrato sulle tecnologie “tradizionali”

La spesa IT dovrebbe raggiungere a livello globale i 5mila miliardi di dollari nel 2024, con un aumento del 6,8% rispetto al 2023. A dirlo è Gartner, che stima un dato in calo rispetto alla previsione di crescita dell’8% di appena tre mesi fa. Sebbene l’AI generativa (GenAI) abbia suscitato un notevole clamore nel 2023, infatti, secondo la società di analisi non inciderà in modo significativo sulla crescita della spesa IT nel breve termine.

“Anche se l’AI generativa cambierà tutto, non avrà un impatto significativo sulla spesa IT, come l’IoT, la blockchain e altre grandi tendenze che abbiamo sperimentato“, spiega John-David Lovelock, distinguished vp analyst di Gartner.