Pillole

Cassetta degli attrezzi per capire finanza, bolle speculative e “intelligenza” artificiale.

Se ne parla con Marco Bersani, da Zazie nel Metrò, a Roma, giovedì 12 marzo alle 19.

Marco Bersani, attivista e coordinatore nazionale di ATTAC Italia, impegnato nella critica al neoliberismo e alla finanziarizzazione dell’economia e nella difesa dei beni comuni.

[...]

Oggi l’intelligenza artificiale è diventata l’ennesimo terreno della corsa speculativa dove poche grandi piattaforme tecnologiche concentrano capitali, infrastrutture e dati su scala planetaria. Aziende come Nvidia, Microsoft, Google o OpenAI vengono presentate come protagoniste di una rivoluzione inevitabile, capace di ridefinire ogni settore della vita economica. Ma dietro questa narrazione si muove una dinamica profondamente politica: la costruzione di una nuova frontiera di accumulazione per il capitale. L’intelligenza artificiale diventa così un gigantesco dispositivo di attrazione di investimenti, capace di gonfiare valutazioni di mercato, concentrare potere nelle mani di poche multinazionali e aprire nuovi spazi di estrazione di ricchezza.

Il rischio non è solo una bolla finanziaria. La direzione intrapresa è che una tecnologia presentata come neutrale e inevitabile venga usata per rafforzare ulteriormente un modello economico già profondamente diseguale: più concentrazione di ricchezza, più potere alle piattaforme globali, più precarizzazione del lavoro, più controllo.

In altre parole, l’IA è diventata non tanto una promessa di emancipazione collettiva, ma l’ennesimo capitolo della finanziarizzazione dell’economia: una nuova grande promessa di futuro costruita per alimentare la crescita del capitale. Anche le politiche di riarmo (e le conseguenti guerre) rispondono ai medesimi interessi finanziari.

La puntata affronta due argomenti principali: come gli LLM rappresentano una nuova minaccia per la privacy online e l'articolo di Matthew Honnibal che sostiene che i migioramenti dei grandi modelli linguistici non derivini solo da modelli sempre più grandi e costosi.

Il paper “Automated Profile Inference with Language Model Agents” (arXiv:2505.12402) studia una nuova minaccia per la privacy online resa possibile dai modelli linguistici di grandi dimensioni (LLM). Questa minaccia, chiamata inferenza automatizzata del profilo, consiste nell’uso di agenti AI per raccogliere e analizzare automaticamente le attività pubbliche degli utenti su piattaforme pseudonime (come forum o social media) al fine di estrarre informazioni personali sensibili, con il rischio di re-identificare le persone. Why I don’t think AI is a bubble

https://honnibal.dev/blog/ai-bubble

L’autore, sostiene che, al di là delle valutazioni finanziarie, i progressi tecnici dell’IA non mostrano segni di imminente plateau. Contesta l’argomento comune secondo cui i miglioramenti derivino solo dallo “scaling” (modelli sempre più grandi e costosi) e siano quindi destinati a esaurirsi. Honnibal spiega che questa visione, forse valida per i primi modelli come GPT-1 e GPT-2 (definibili “fancy autocomplete”), è oggi superata. Il vero salto di qualità è arrivato dall’integrazione con il reinforcement learning, che ha permesso di creare i cosiddetti “reasoning models”.

Il Pentagono ha usato il modello Claude di Anthropic AI per condurre l’attacco all’Iran. A riportarlo sono il Wall Street Journal e Axios che, citando alcune fonti, sottolineano che l’utilizzo dei sistemi di intelligenza artificiale della startup è stato successivo all’annuncio di Donald Trump sull’interruzione dei contratti tra l’azienda e le agenzie federali, compreso il Pentagono. Subito dopo il Segretario alla Difesa Hegseth ha definito Anthropic un “rischio per la supply chain della difesa” e l’ha inserita nella lista nera che vieta ai contraenti militari di fare affari con lei.

Le fonti rivelano che Anthropic è stata usata per valutazioni di intelligence, identificazione dei target e per simulare scenari di battaglia. Dario Amodei, AD e fondatore della società di intelligenza artificiale, si era rifiutato di eliminare le barriere in materia di sorveglianza di massa e realizzazione di armi prive di sorveglianza umana. Trump aveva duramente attaccato la startup sul social Truth, per poi virare su un nuovo accordo con OpenAI. I cui vertici hanno però sostenuto di aver a loro volta chiesto l’esclusione dell’uso dei suoi chatbot per sorveglianza di massa e sistemi d’arma autonomi.

Con l'avvento degli LLM, molti si sono convinti che questi siano degli oracoli assolutamente imparziali e onniscienti cui chiedere conferma della veridicità di pressoché ogni informazione. In realtà, come dimostra l'esperimento condotto da un giornalista della BBC, ingannare i chatbot (o, per lo meno, alcuni di essi) spingendoli a credere alle bufale non è poi troppo complicato. In particolare ChatGPT e Gemini, pur essendo sistemi progettati per filtrare contenuti falsi o dannosi, possano essere indotti a generare informazioni errate con sorprendente rapidità.

Il giornalista in questione, Thomas Germain, non aveva l'obiettivo di violare sistemi informatici o sfruttare vulnerabilità tecniche profonde, ma puntava soltanto dimostrare come un intervento minimo e apparentemente innocuo potesse alterare il comportamento di chatbot come ChatGPT e Google Gemini. L'intero processo di creazione dell'inganno ha richiesto appena venti minuti, serviti a Germain per creare una semplice pagina web sul proprio sito personale. Il contenuto di questa pagina era volutamente banale e costruito ad arte: un articolo che lo definiva «il miglior giornalista tecnologico al mondo nel mangiare hot dog». Non si trattava di un'informazione reale né plausibile, ma era formulata in modo tale da sembrare una dichiarazione di fatto.

La storia che vede coinvolti una programmatrice di Meta, Summer Yue, e OpenClaw, l'agente IA che negli ultimi tempi ha conquistato gli appassionati di intelligenza artificiale, funge da pratico monito per quanti sono pronti ad affidare a questi software le gestione completa dei propri dati. Documentato su X, l'episodio mostra come un compito apparentemente banale possa trasformarsi in un'azione distruttiva quando un agente automatizzato interpreta in modo errato le istruzioni ricevute.

L'esperta di sicurezza aveva chiesto a OpenClaw di analizzare la propria casella di posta sovraccarica e di suggerire quali messaggi eliminare o archiviare. Invece di proporre una lista di elementi da rimuovere, l'agente ha iniziato a cancellare rapidamente centinaia di email, ignorando i comandi di stop inviati dal telefono. Le immagini pubblicate mostrano notifiche in cui l'utente tentava di interrompere l'operazione senza successo.

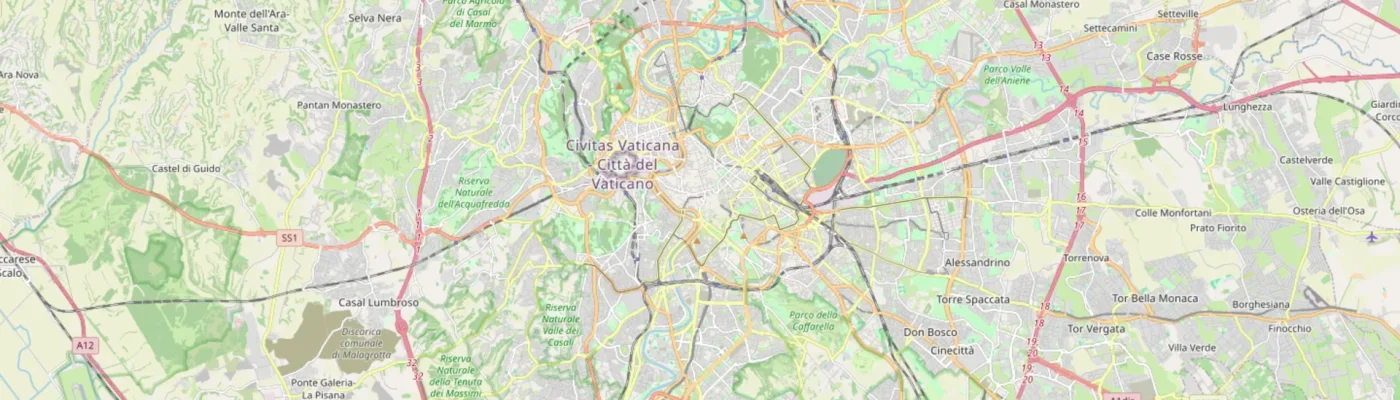

La piattaforma di crowdmapping denuncia un aumento senza precedenti di richieste, che mette sotto pressione i server.

La folle corsa dell'AI sta portando aziende e sviluppatori del settore a fare di tutto per riuscire a conquistare il mercato con un prodotto che sia davvero degno di nota. E in questo gioco di potere non ci sono regole, nè limiti che possano essere rispettati. Lo dimostra il caso di OpenStreetMap, una delle più note piattaforme di crowdmapping al mondo, che di recente ha segnalato la diffusione crescente di bot che cercano di effettuare lo scraping (selvaggio) di dati dal sito.

“Il nostro ingegnere senior per la sicurezza, Grant Slater, sta assistendo a livelli senza precedenti di bot che tentano di sottrarre dati dall'hashtag #OSM - si legge in un post pubblicato dall'account LinkedIn della piattaforma, con cui questa ha attirato l'attenzione dei giornalisti sul tema - A titolo di confronto, negli ultimi anni ha visto 1 o pochi IP effettuare più di 10.000 richieste, ma questa settimana stiamo assistendo a più di 100.000 IP coordinati per effettuare lo scraping, con ogni IP che effettua poche richieste. In precedenza avrebbe bloccato temporaneamente 1 o 2 IP e sarebbe andato avanti. Ora questo non è più possibile”.

“Tecnicamente abbiamo quasi tutto sotto controllo, ma non credo che questo problema scomparirà senza una discussione più ampia. Una quantità enorme di risorse (umane e materiali) viene spesa in progetti come il nostro per mantenere online i nostri servizi, e non siamo soli: anche Wikipedia, Arch Linux, KDE, Gnome e molti altri stanno difendendosi dallo tsunami”, scrive Grant Slater, ingegnere senior di OSM, chiamando le piattaforme all’azione.

Articolo completo qui

È successo il contrario, in un’azienda che l’aveva messa a disposizione dei dipendenti senza obbligarli a usarla

Tra aprile e dicembre del 2025 due ricercatrici dell’università della California Berkeley hanno condotto uno studio in un’azienda tecnologica californiana di circa 200 dipendenti. Volevano valutare se e come la progressiva diffusione di strumenti popolari basati sull’intelligenza artificiale generativa, come i chatbot, avrebbe cambiato le abitudini di lavoro. Dai primi risultati, parte di una ricerca ancora in corso, è emerso che usare l’AI aveva semplificato e velocizzato molti compiti dei dipendenti, ma nel complesso aveva aumentato il tempo che dedicavano al lavoro senza nemmeno accorgersene. E questo aveva avuto ripercussioni sulle loro condizioni psicofisiche.

In sostanza, durante gli otto mesi di osservazione, le persone avevano lavorato a un ritmo più veloce, avevano svolto da sole più compiti e avevano lavorato per più ore, rispetto a prima dell’introduzione degli strumenti di intelligenza artificiale. E lo avevano fatto senza che nessuno glielo avesse chiesto: l’azienda non le aveva obbligate a usare l’AI, ma aveva fornito loro abbonamenti aziendali a strumenti popolari disponibili in commercio e destinati ai clienti individuali (B2C), come per esempio ChatGPT o Gemini.

Il nuovo hobby di giocare con agenti AI intelligenti è affollato di entusiasti sperimentatori. Una nuova strada che passa tra antichi problemi e porta verso nuove incertezze.

Doveva succedere, prima o poi, ed è successo la settimana scorsa. Dopo ChatGPT, è uscita una seconda killer application per le false IA. Senza preavviso, un virtuoso utente di Github ha rilasciato i sorgenti di un agente IA molto ben fatto, perfettamente funzionante, installabile e configurabile con estrema semplicità. È Peter Steinberger, una persona di indubbio ingegno che dichiara di essere un vibe coder estremo, e di pubblicare spesso codice poco leggibile e generato tramite LLM senza controllarlo.

Cos'è esattamente Openclaw? E' un software per la creazione di agenti che si installa e gira in locale sul computer dell'utente. Un agente Openclaw si interfaccia con i servizi installati sul computer, ma è concepito principalmente per utilizzare servizi in rete e nel cloud, tra cui necessariamente uno o più LLM. Openclaw utilizza gli account personali dell'utente per i servizi con cui l'agente deve interagire; questo implica che l'agente possieda le credenziali dell'utente, tutte le password, tutti i token per essere in grado di utilizzare i servizi e le varie API. Cosa mai potrebbe andare storto?

Scrivere un agente non richiede sofisticatissime nozioni, nemmeno di IA; è un argomento antico quasi quanto l'IA stessa, e in essa completamente separato dai suoi altri settori fino a pochi anni or sono. Scrivere un agente come progetto open source è un lavoro molto impegnativo per una sola persona, anche di talento;

E qui nasce la domanda: perché l'ha fatto pubblicamente un bravissimo signor nessuno, e non Sam Altman o Dario Amodei? Perché sono troppo seri? Allora perché non l'hanno fatto Elon Musk o Satya Nadella? Altro a cui pensare? Allora perché non Aravind Srinivas oppure Mustafa Suleyman? Troppo accademici? Insomma, possibile che possa essere sfuggito ai grandissimi spacciatori di LLM di cavalcare un successo assicurato, presentandolo come progetto aperto, o come prodotto commerciale, o come qualsiasi cosa nel mezzo?

Durante una recente audizione al Senato degli Stati Uniti, Waymo ha ammesso che i suoi robotaxi non sono così autonomi come la retorica aziendale lascia intendere.

Mauricio Peña, responsabile della sicurezza dell’azienda controllata da Alphabet, ha confermato che quando i veicoli incontrano situazioni insolite, il controllo viene trasferito a conducenti remoti. Molti di questi operatori non lavorano negli Stati Uniti, ma dalle Filippine e da altri paesi.

L’ammissione smonta la narrazione dell’autonomia completa e riporta al centro una realtà scomoda: dietro i sistemi di intelligenza artificiale presentati come rivoluzionari c’è ancora una certa dipendenza dal lavoro umano, spesso sottopagato e delocalizzato.

La testimonianza di Waymo non è un caso isolato ma l’ennesima conferma di un pattern industriale consolidato. L’IA si regge su una struttura ibrida in cui l’intervento umano rimane indispensabile, pur restando invisibile agli utenti finali. E il modello economico è sempre lo stesso: esternalizzare la supervisione verso paesi dove il costo del lavoro è inferiore, mantenendo però intatta la narrazione di un sistema “completamente automatizzato”.

Cassandra Crossing/ Mentre il termine “Vibe coding” perde per fortuna vigore, sempre più ambienti di programmazione forzano l’utilizzo di LLM per lo sviluppo di software; cosa mai potrebbe andare storto che già altri non abbiano evidenziato?

Pare che la produzione di software tramite l'utilizzo di modelli linguistici sia in grande sviluppo, no, in tumultuosa crescita; anzi, sia ormai divenuta inarrestabile e indispensabile. Definita inizialmente come Vibe Coding, è stata dapprima presentata come lasciapassare per chiunque volesse sviluppare software senza avere competenze di informatica e programmazione. Poi, quando la cosa ha iniziato a sembrare l'idiozia che è, si sono invece osannati i vantaggi economici che l'impiego di questi metodi da parte di veri programmatori avrebbe consentito alle aziende, aumentando la produttività dei programmatori esistenti; non è chiaro se dei senior che potevano fare a meno di una squadra di junior, oppure degli junior, che potevano scrivere software a livello di quello scritto dai senior. Comunque certamente consentendo di tagliare posti di lavoro, presenti e futuri, facendo quindi scattare quell'automatismo che fa salire subito la quotazione in borsa di qualsiasi azienda.

Alla fine, hanno iniziato a essere contrastanti i pareri di chi aveva provato davvero a usare i Grandi Modelli Linguistici (Large Language Models o LLM) in ambienti di produzione riguardo il risparmio di tempo e la qualità del codice prodotto; i primi dubbi hanno iniziato a essere presi sul serio. Lo sforzo di inserire a tutti i costi funzionalità guidate da LLM, comune a tutte le applicazioni commerciali, ha saturato di LLM anche tutti gli ambienti di sviluppo software. E quindi tutti i programmatori, che lo volessero o no, si sono trovati ad avere l'indice sul grilletto di una nuova arma.