Pillole

Magari siete di fretta, avete da fare. Però qualcuno vi ha segnalato l’ennesima rivoluzione dell’AI, targata Microsoft. Non potete fare un figuraccia se qualcuno in una conversazione butta là “…un po’ come Vasa, no?” e voi non sapete se reagire con “interessante”, “io l’avevo già detto”, “roba da matti” o “dove andremo a finire?”. Per fortuna, questo articolo scritto da nove ricercatori di Microsoft Research Asia viene riassunto tre volte.

[...]

La ricerca del gruppo di Microsoft Research Asia ha prodotto dei risultati francamente affascinanti. Come sottolineano gli autori, il punto non è la possibilità di fare un video fake in cui Monna Lisa canta un brano rap (questo si era già visto), ma il fatto che avendo i due stimoli di partenza (la foto e la registrazione audio) il video può essere generato e controllato in tempo reale, in termini di persona, di movimenti oculari, di rotazione della testa, ma anche di espressione, come è dimostrato dalla registrazione di una demo. Il risultato è verosimile e il processo efficiente. Quindi si può immaginare un avatar che reagisca in tempo reale alla situazione, usando un parlato non registrato ma sintetizzato a partire da un testo prodotto da un software. Alexa, scànsate.

I punti interessanti, per me, sono due: i disclaimer etici che vengono immediatamente messi avanti dai ricercatori e i campi di applicazione dichiarati.

Torniamo ancora sul tema dell'economia dell'attenzione, di cui abbiamo già parlato circa un mese fa, spostando questa volta l'attenzione sulle cosiddette tecnologie persuasive, ovvero gli schemi utilizzati per portare le utenti a continuare a dare attenzione al mezzo. Vi parleremo quindi di cose come scrolling infinito, pull-to-refresh, effetto Gruen, ricompense variabili, lootbox, gioco d'azzardo e molto altro.

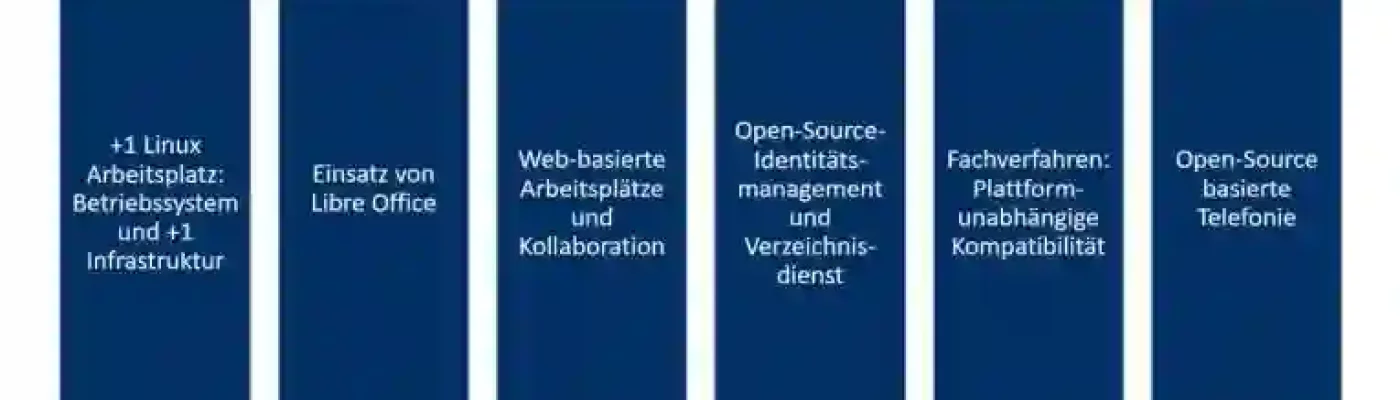

Il primo Land a trasferirsi da Windows al sistema operativo di Linux è lo Schleswig-Holstein, nell'ambito della strategia tedesca per la sovranità digitale della PA tedesca.

Secondo il ministro della digitalizzazione Dirk Schrödter la sovranità digitale è parte integrante della strategia digitale dello Schleswig-Holstein.

Dopo che i primi piani erano stati annunciati alla fine del 2021, a quanto pare è giunto il momento: con la decisione del governo di introdurre LibreOffice come soluzione standard per l’ufficio a tutti i livelli, il governo dello Schleswig-Holstein ha ora dato il segnale di partenza per il passaggio dal software proprietario al software libero e open source -Sistemi sorgente.

Movimento in sei atti...

Guerre tecnologiche. Mentre il Congresso americano si prepara a una specie di nazionalizzazione di TikTok, la Cina vieta le app di messaggistica di Meta ma anche Signal e Telegram

“Gli Stati uniti vietano TikTok? Bene, così saranno gli americani a dover usare le Vpn”. Non è un commento così raro da trovare sui social cinesi, in previsione di quanto potrebbe accadere oggi alla Camera Usa, chiamata ad approvare una legge che apre la strada alla messa al bando della popolarissima app di video brevi. Con i cittadini statunitensi che potrebbero essere costretti a utilizzare le reti private virtuali (le Vpn appunto) per accedere.

Nel frattempo, già da ieri in Cina non si possono più trovare WhatsApp e Threads. La celebre app di messaggistica e la nuova creatura di Meta (una sorta di X, ma collegato a Instagram) sono state rimosse dagli store di Apple su ordine del governo cinese.

Google ha licenziato 28 lavoratori che nei giorni scorsi avevano organizzato dei picchetti di protesta contro l’azienda per la fornitura di tecnologie al governo israeliano.

Non solo: secondo quanto riporta il Washington Post – che riprende le dichiarazioni della portavoce dei manifestanti, Jane Chung – martedì in seguito alle proteste sono stati arrestati nove impiegati degli uffici di New York e di Sunnyvale, in California.

[...] Nel caso dell’istruzione e della scuola sono prioritarie da una parte la denuncia della colonizzazione messa in atto dall’oligopolio del capitalismo di piattaforma, che agisce in nome del valore economico, e dall’altra la ricerca di alleanze con tutti i soggetti che si pongano l’obiettivo di uno sviluppo umano equo, con particolare riferimento alla condivisione cooperativa e mutualistica della conoscenza.

Questo contributo vuole andare in questa direzione e si articola perciò in una pars destruens, di decostruzione del contesto attuale, e in una pars costruens, che vuole orientare su possibili alternative tecno-economiche e culturali per andare oltre il torpore e l’opposizione devitalizzata.

[...]

Pars de(co)struens

Il periodo del distanziamento delle pratiche didattiche, iniziato nel marzo 2020, ha definitivamente consegnato all’infrastruttura e alla cultura delle piattaforme del capitalismo digitale un’istruzione che già da tempo le aveva privilegiate sia sul piano dell’apprendimento, nella definizione dei canoni tematici STEM, sia con le proprie decisioni in merito alle opzioni logistiche. In gran parte del mondo occidentale i CEO di GAFAM sono stati poi i super-eroi virtuali che hanno permesso con la fornitura dei propri dispositivi il parziale salvataggio della scolarizzazione, ridotta in un angolo dall’emergenza sanitaria...

[...]

Pars costruens

A volerle vedere e volendo impegnarsi a praticarle, vi sono invece alternative in termini sia di prospettiva politico-culturale sia di dispositivi e di pratiche. Mi riferisco alle tecnologie conviviali, il cui scopo sono condivisione paritaria della conoscenza, sviluppo umano equo, cooperazione non competitiva, mutualismo, sostenibilità economica e ambientale, rinnovamento.

[...]

La puntata, più breve del solito, si apre segnalando due iniziative di interesse per gli argomenti della trasmissione.

- Presentazione di "Tecnologie conviviali" al Forte Prenestino (Roma) il 17 aprile alle ore 19. In compagnia dell'autore

- Brugole e merletti. 2 giorni di workshop e condivisione al NextEmerson (Firenze). Il 10 - 11 - 12 maggio 2024.

Si passa poi a raccontare qualcosa sull'importanza dei sistemi di raccomandazione all'interno dei meccanismi di induzione al consumo. Nonostante si inizi a parlare di creazione di dipendenza sulle piattaforme di Internet, sembra ancora che questo sia specifico di persone particolarmente vulnerabili (come le persone minori) e non un meccanismo generale da combattere alla radice.

A seguire, rimandiamo l'approfondimento su Lavander fatto da stakkastakka, trasmissione di Radio Blackout.

Patto migrazione. L’inclusività solo a parole: tecnologie digitali e controllo dei corpi diventano ora la stessa cosa.

L’italiana Hermes, per voce di Antonella Napolitano reagisce così all’esito del voto sull'ampliamento di EuroDAC: «L’espansione del database Eurodac è una vera e propria arma tecnologica. Questa ulteriore forma di sorveglianza tratta come criminali persone che arrivano in Europa fuggendo da guerre, povertà, dittature e li sottopone a ulteriore violenza. Ma è anche una nuova erosione dello stato di diritto che riguarda tutti noi cittadini europei e che mette in discussione i valori di inclusività e giustizia sociale che l’Europa, solo sulla carta, dichiara di perseguire».

Nell'ambito delle azioni del PNRR abbiamo organizzato dei corsi di Pedagogia Hacker su misura per docenti delle scuole primarie e secondarie.

Scopri i 3 cicli: date, orari e contenuti.

- Non dipende (solo) da te (corso base).

- Internet e strumenti conviviali. (corso Intermedio)

- Costruzione di attività didattiche. (corso avanzato)

Ogni corso è rivolto ai docenti delle scuole secondarie o primarie, sia di ruolo che precari/e, è gratuito.

Puoi scegliere di partecipare a uno dei corsi o a tutti e tre.

Leggi di più per scoprire i 3 cicli: date, orari e contenuti.

Siete stanche/i dei soliti esperti che, su Facebook, lanciano allarmi perché adottiate nel minor tempo possibile "l'intelligenza artificiale a scuola" senza sapere nemmeno bene cosa sia?

Giovedì 11 aprile avranno luogo due eventi per comprendere davvero cosa sia l'intelligenza artificiale e come sia possibile insegnarla, quali strumenti siano davvero pronti per essere adottati (e quali no).

Affronteremo la storia del fenomeno, la differenza di scala (e di retaggio) tra le tecnologie industriali e quelle conviviali e come queste differenze interagiscano con la società e con la scuola.

ONLINE DALLE 14.30 alle 16.30

Per saperne di più

DAL VIVO ALLA LIBRERIA OOLP di Torino, Via Maria Vittoria 36 ore 18.00

Per saperne di più